Hozhat-e az AI alapvetően etikus döntéseket? Ha jogellenes ítéletet hoz, kit büntetnek meg? A hatékonyságra és gyorsaságra való törekvésben rábízhatjuk-e az emberek sorsát a mesterséges intelligenciára?

Képzeljünk el egy tárgyalótermet, ahol a mesterséges intelligencia (AI) helyettesíti az esküdteket, és egy tökéletesen megtervezett AI-ügynök helyettesíti az ügyvédet.

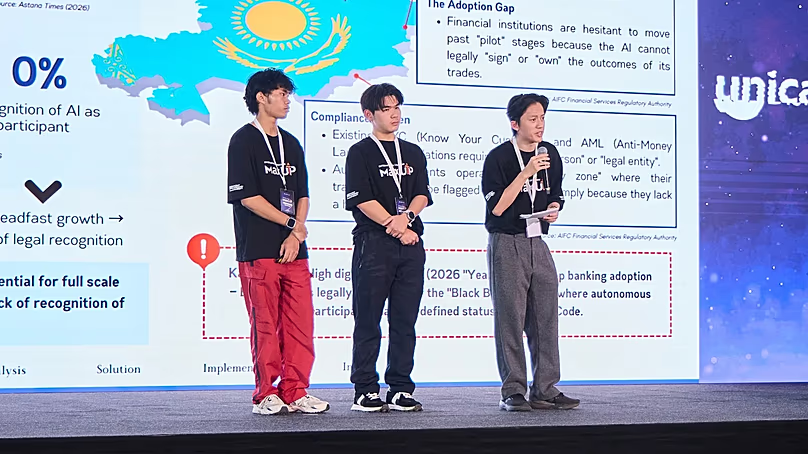

Pontosan ez a forgatókönyv gondolkodott el a Nemzetközi MaxUp Legathonon, amelyre Kazahsztán fővárosában, Asztanában került sor.

Itt, a Maqsut Narikbayev Egyetemen 13 ország diákjai fedezték fel az új technológiák, például a mesterséges intelligencia hatását a jogrendszerekre, a jogi elvekre, az etikára és az emberi jogokra, és megosztották egymással tapasztalataikat saját országaikból.

Az AI helyettesítheti a bírókat?

A bírói döntések tényelemzést, erkölcsi érvelést és emberi empátiát igényelnek a tisztességes megoldás eléréséhez.

Először is, a mesterséges intelligenciának nincsenek érzelmei. Nem ajánlhat enyhítő körülményeket, nem mutathat empátiát a helyzet iránt, és nem érezhet együttérzést. Az AI-rendszerek az ismétlésre épülnek. Tanulnak az adatokból, azonosítják a mintákat, és tapasztalatok alapján hoznak döntéseket.

Ha a korábbi tapasztalatok eredménye hibás volt, az AI ugyanúgy helytelenül oldja meg a hasonló eseteket.

Eközben a modern AI-botok az adatok szisztematikus ismétlődésén alapuló konkrét eredményt produkálnak. Gyakran elmulasztják megmagyarázni azt a logikai láncot, amelyen keresztül egy adott választáshoz jutottak. A bíróságokon azonban ez az indoklás döntő jelentőségű.

Sergey Pen, az asztanai Maqsut Narikbayev Egyetem (MNU) tudományért, innovációért és mesterséges intelligenciáért felelős igazgatótanácsának alelnöke úgy véli, hogy ezen okok miatt az AI-nak jelenleg nincs esélye a bírák leváltására.

Szerinte a nyelvi modell csak tudásbázisa és statisztikai kontextuális egyezései alapján ad választ, az emberi bíró által adott érvelést mellőzve.

„Óriási probléma van, mivel a nyelvi modellek nem képesek reprodukálni az érvelés jogi láncát, vagy az úgynevezett jogi érvelést” – mondta Pen.

Szerinte manapság az AI-ra csak az emberi döntéshozatal melletti eszközként kell tekinteni.

Kazahsztánban az ilyen eszközök felülvizsgálják a bírói gyakorlatot és elemzik a jogszabályokat. Nagy mennyiségű információt gyorsabban tud feldolgozni. Létezik egy igazságügyi rendszer is, amely a mesterséges intelligenciát már hivatalos célokra használja belső eszközként, hogy segítse a bírákat a következetes bírói gyakorlat követésében, és megtudja, milyen döntéseket hoznak hasonló típusú vitákban Kazahsztánban.

Ez azonban nem helyettesíti vagy helyettesíti magának a döntésnek a legitimitását, amely kizárólag az embereken múlik.

„Csak egy bíró, mint emberi lény, legitimálhat és hozhat bírósági határozatot” – magyarázta Pen.

Hogyan működik az AI jogi ügyekben más országokban?

Kínában a mesterséges intelligencia már belépett a tárgyalóterembe, a Kínai Politikatudományi és Jogi Egyetem hallgatója megjegyezte, hogy az MI-t alapvető és egyszerű feladatokban használják.

„Az én országomban ma már kitöltik az üres helyeket, és talán segít az esküdtszéknek bizonyos ügyek megtalálásában (elemzésben, hogy az eset hasonló-e az előzőekhez), de az MI nem dönthet csak az eredményről” – mondta Hongyi Chen kínai joghallgató.

Grúziai diákok átfogó kutatást végeztek, hogy megértsék, hogyan működhet a mesterséges intelligencia a jogrendszeren belül. A nemzetközi gyakorlatot elemezve rávilágítanak a technológiai megvalósíthatóság és a jogi legitimitás közötti szakadékra.

A fő kockázat a lélek hiánya az algoritmusban és az etikus választás lehetetlensége.

„Egyelőre az emberi bírónak, mint választottbírónak még érdemben kell mérlegelnie az ügyet, és csak ezután válik kötelező érvényűvé a jogi megoldás. De ha már elértük az MI alkalmazásának ezt a szintjét, akkor szerintem fennáll a lehetőség, hogy a mesterséges intelligencia a jövőben ítéletet hozzon” – mondta Keti Khaliashvili, a Tbiliszi Egyetem hallgatója.

A kanadai McGill Egyetem hallgatói megjegyezték, hogy meg kell vizsgálni és szabályozni kell az AI jogi kérdésekbe való integrálását.

„Személy szerint jelenleg úgy érzem, hogy a mesterséges intelligencia még nem fejlődött annyira, hogy teljesen helyettesíthetné az emberi ítélőképességet” – jegyezte meg Elisa Xue diák.

A felelősség dilemma

A legalapvetőbb ok, amiért a mesterséges intelligencia nem helyettesítheti az embereket, a felelősség. A bírósági határozat hatósági aktus, amelyért a bírák felelősséggel tartoznak. Ha a bíró hibázik, fellebbezést lehet benyújtani, fegyelmi eljárást lehet indítani, vagy az ügyet törvényben lehet rendezni.

De a mesterséges intelligencia esetében ki a hibás? A kódfejlesztő vagy a felhőszolgáltató?

Az MNU hallgatói úgy vélik, hogy meg kell határozni, ki viseli a felelősséget.

„Ha a mesterséges intelligencia által generált tartalom kárt okoz, felelős-e, és szükséges-e az „AI” címkézés? Nincsenek olyan kategóriák a törvényben, amelyek különbséget tesznek ártalmatlan, káros vagy potenciálisan káros tartalom között. A jognak adaptálhatónak kell lennie, és a jogviszonyok különböző szintjein kell alkalmazni” – érvel az MNU hallgatója, Islam Shagatayev.

A legathon győztesei egyetértenek vele, és a gyártók és rendszerfejlesztők abszolút felelősségének bevezetését javasolják.

„Úgy gondoljuk, hogy az egyén vagy a felhasználó nem mindig részesül semmilyen védelemben. Ezért a fejlesztőnek kell viselnie a felelősség nagy részét” – mondta Alissa Doktorovich, az Al-Farabi Kazakh National University hallgatója.

Az a tény, hogy Kazahsztánban most zajlanak a mesterséges intelligencia megbeszélései, szimbolikus, hiszen 2026 itt a digitalizáció és a mesterséges intelligencia éve.

Az ország 2025 novemberében elfogadott mesterséges intelligenciáról szóló törvénye bevezette és rögzítette az antropocentricitás elvét, ami azt jelenti, hogy a mesterséges intelligencia csupán egy eszköz, amely utánozza az emberi kognitív funkciókat, és nem helyettesíti az emberi felelősséget.

A Legathon lehetővé teszi számunkra, hogy újragondoljuk és újraértékeljük a mesterséges intelligencia és a törvény közötti kapcsolatot. Egy olyan korszakban, amikor a jog egyre inkább algoritmikussá válik, emlékeznünk kell az emberi elemre.