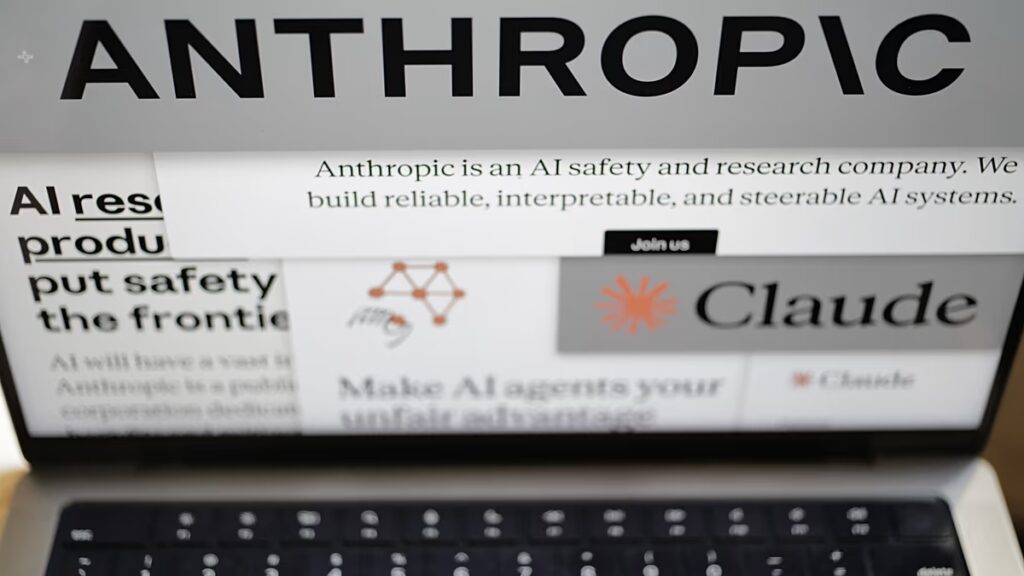

A Pentagon a múlt héten az Anthropicot ellátási lánc kockázatának minősítette, ami azt jelenti, hogy a vállalatoknak fel kell hagyniuk Claude használatával a védelmi osztályon.

Az Anthropic hétfőn beperelte az Egyesült Államok Védelmi Minisztériumát a bíróságon, miután az ügynökség a múlt héten ellátási lánc kockázatának minősítette.

A jogi panasz az Anthropic és a DOD közötti konfliktus után érkezett arról, hogy a hadseregnek korlátlan hozzáférést kell-e biztosítani az Anthropic mesterséges intelligencia rendszereihez.

A Pentagon a múlt héten szankcionálta a Claude gyártót, és úgy ítélte meg, hogy ez az ellátási lánc kockázata, ami azt jelenti, hogy a vállalatoknak fel kell hagyniuk a Claude használatával a részleghez közvetlenül kapcsolódó esetekben.

Donald Trump elnök azt is kijelentette, hogy elrendeli a szövetségi ügynökségeket, hogy hagyják abba a Claude használatát, bár hat hónapot adott a Pentagonnak egy olyan termék fokozatos megszüntetésére, amely mélyen beágyazott titkosított katonai rendszerekbe, beleértve az iráni háborúban használtakat is.

„Nem hisszük, hogy ez az intézkedés jogilag megalapozott, és nem látunk más választást, mint bíróság előtt megtámadni” – írta csütörtöki blogbejegyzésében az Anthropic vezérigazgatója, Dario Amodei.

A perben azt kérték, hogy a bíró fordítsa meg az „ellátási lánc kockázati címkéjét”, és akadályozza meg a szövetségi hivatalok érvényesítését.

Az alkotmány nem teszi lehetővé a kormánynak, hogy hatalmas hatalmával megbüntessen egy vállalatot a védett beszédéért” – mondta Anthropic a beadványban. „Az Anthropic végső megoldásként az igazságszolgáltatáshoz fordul, hogy igazolja jogait és leállítsa a végrehajtó hatalom törvénytelen megtorlási kampányát.”

A védelmi minisztérium hétfőn megtagadta a kommentárt, arra hivatkozva, hogy nem kommentálja a peres ügyeket – jelentette az AP.

Az Anthropic azt mondta, hogy technológiáját két magas szintű felhasználásra próbálta korlátozni: az amerikaiak tömeges megfigyelésére és a teljesen autonóm fegyverekre.

Pete Hegseth védelmi miniszter és más tisztviselők nyilvánosan kitartottak amellett, hogy a cégnek el kell fogadnia Claude „minden törvényes felhasználását”, és büntetéssel fenyegetőzött, ha az Anthropic nem tesz eleget.

Az Anthropic készíti a Claude chatbotot, és az utolsó olyan társa, amelyik nem szállítja technológiáját egy új amerikai katonai belső hálózatnak.

Az Anthropic tavaly júliusban 200 millió dolláros (167 millió eurós) szerződést nyert az Egyesült Államok védelmi minisztériumától, hogy „az Egyesült Államok nemzetbiztonságát előmozdító határ menti mesterséges intelligencia-képességek prototípusaként működjön” – mondta Anthropic.

A vállalat 2024-ben együttműködési szerződést írt alá a Palantir Technologies társasággal, hogy integrálja Claude-ot az amerikai hírszerzési szoftverekbe.